Тези кадри са създадени с AI и не показват удари срещу военни бази в Близкия изток

- Публикувано на 24 март 2026 г. в 16:49

- Време за четене: 6 минути

- От: Bozhidar ANGUELOFF, AFP България

През март 2026 г. Иран нанесе множество удари по американски бази в Близкия изток в отговор на съвместните удари на Израел и САЩ срещу страната, които поставиха началото на нова война в региона. На този фон в социалните мрежи започна да се разпространява видео, за което се твърди, че показва удар по американска база. Потребители споделят и изображение, което трябва да показва сателитен изглед към иранско летище с щети от въздушни удари. Проверка на Агенция Франс-Прес (AFP) обаче установи, че клипът и изображението са създадени с изкуствен интелект (AI).

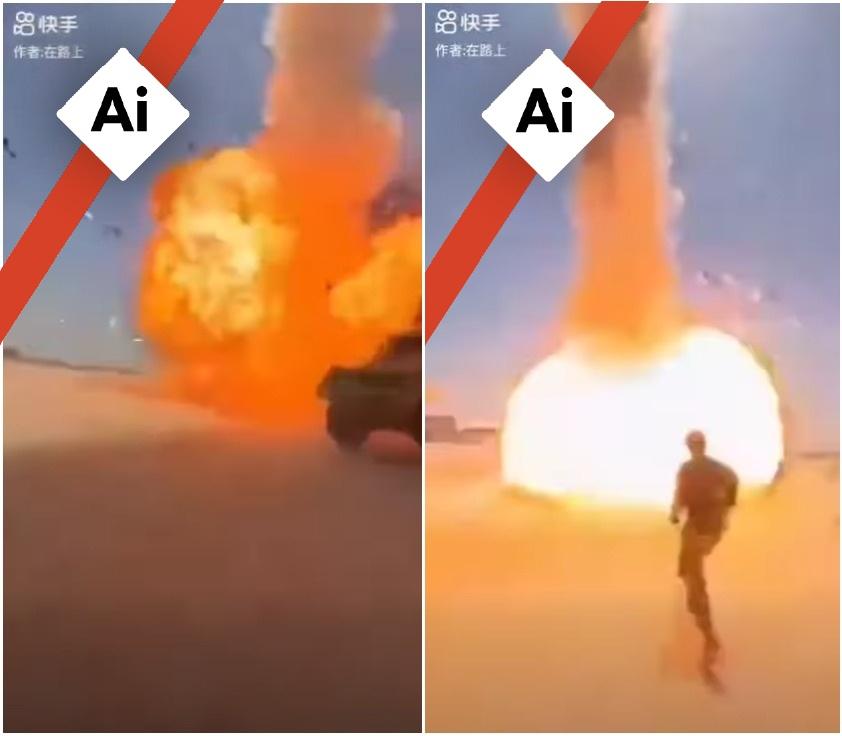

"Китай пусна скрити кадри, какво наистина става в "хам*ериканските" 6ази при бомбардировка", пише във Facebook публикация от 11 март 2026 г. Постът съдържа 60-секундно видео, на което се вижда как ракети се взривяват на място, приличащо на военна база, докато хора в камуфлажни униформи бягат и приканват други да се укрият от ударите.

Първите кадри от видеото се разпространяват и в по-кратък 15-секунден клип, публикуван от друг потребител в социалните мрежи на 11 март. Двата поста са споделени общо над 320 пъти.

Друго широко разпространявано изображение показва сателитен изглед към кратер от удар, от двете страни на който се виждат нарисувани силуети, наподобяващи военни изтребители. Според твърдението американски и израелски пилоти са били подведени да бомбардират рисунки на ирански самолети.

"Срам за САЩ и Израел: "Унищожени" ирански самолети на летища се оказаха чертежи", пише във Facebook пост от 6 март 2026 г. Тази публикация от 7 март споделя същите текст и изображение. Двата поста са споделени общо над 200 пъти.

Същото изображение циркулира и на други езици, сред които английски, испански, гръцки, румънски.

Войната в Близкия изток започна на 28 февруари, след като Израел и САЩ нанесоха удари по Иран, при които беше убит върховният лидер на Ислямската република аятолах Али Хаменей. В отговор Иран извърши поредица ответни удари, включително по американски военни бази.

Към 21 март има съобщения за 13 загинали американски военнослужещи и около 200 ранени в седем страни в Близкия изток. По последни данни 10 от ранените са тежко пострадали, а над 180 вече са се върнали на служба. Базираната в САЩ Human Rights Activists News Agency (HRANA) съобщава за над 3200 убити в Иран, сред които 1400 цивилни, над 1100 военни и близо 700 души с неустановен статут. AFP не успя независимо да потвърди тези данни.

Видеото и изображението, за което се твърди, че е сателитна снимка, са създадени с изкуствен интелект.

Клип със синтетично аудио и визуални неточности

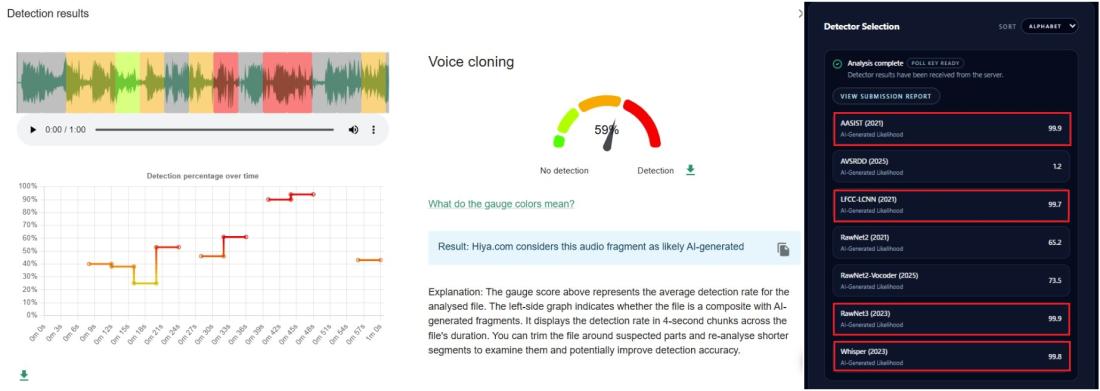

В дългата версия на видеото, споделяно с твърдението, че показва подложена на удари американска база, се виждат войници, които бягат, за да се укрият, и се чуват викове на английски като "идва удар" и "продължавайте". AFP анализира аудиото с два инструмента, предназначени за откриване на съдържание, създадено с изкуствен интелект.

Първо проверихме аудиото с Hiya – инструмент, интегриран в разширението за проверка на фактите InVID-WeVerify, разработено в сътрудничество с AFP. Hiya отчете висока вероятност звукът да е синтетичен – 59%. В тази публикация от ноември 2025 г. Дени Тейсу, ръководител "Иновации" по проектите InVID и WeVerify в AFP, обяснява, че подобен резултат се смята за висок, тъй като ако един аудиофайл е автентичен, "той няма да съдържа следи от генериране с изкуствен интелект".

След това проверихме звука от клипа и с инструмента Deepfake-o-meter – проект с отворен код, разработен от Media Forensic Lab към Университета в Бъфало, който разполага с шест системи за разпознаване на синтетично аудио. Четири от тези системи отчетоха над 99.7% вероятност аудиото да е генерирано с изкуствен интелект.

Забелязахме и различни визуални неточности в клипа, които са характерни за видеа, създадени с изкуствен интелект. Съветите на AFP как да разпознавате AI съдържание може да прочетете тук и тук.

В 10-та секунда от клипа върху униформата на един от войниците, които тичат, се вижда знаме. То наподобява знамето на САЩ, но белите и червените ивици, които трябва да са общо 13 на брой, всъщност са повече (архив). Знамето трябва да има и 50 бели звезди на тъмносин фон, но в кадъра по-скоро се вижда бял фон със сини звезди. Подобни неточности в цветовете на знамена също са типичен белег за съдържание, създадено с изкуствен интелект.

Друга нереалистична сцена може да бъде видяна на 39-та секунда. Снаряд пада само на метри от човек, който уж снима видеото, но заснемането продължава необезпокоявано. Сходна сцена се вижда и в 42-ра секунда.

В тази проверка организацията за проверка на фактите Lead Stories посочва и други визуални неточности. Например в самото начало на видеото се вижда камион, чиито джанти изглеждат изкривени. Малко след това се вижда и войник с прекалено дълга ръка, който изведнъж изчезва.

В горния ляв ъгъл на видеото се вижда воден знак. Първият ред, преведен от китайски, гласи: "Kuaishou". Kuaishou е китайска платформа за кратки видеа, подобна на TikTok. Компанията е създала Kling AI – инструмент за генериране на съдържание с изкуствен интелект.

На втория ред във водния знак пише: "Автор: "По пътя", което вероятно е потребителско име. AFP обаче не успя да открие такъв профил нито в Kuaishou, нито в Kling AI.

При обратно търсене в Baidu – най-голямата търсачка в Китай – AFP откри по-ранна и по-дълга версия на видеото, публикувана в китайски сайт на 10 март. Тя е с продължителност 62 секунди.

Видеото е публикувано със заглавие: "Американската военна база беше атакувана! Напрежението между САЩ и Иран отново ескалира." Под него обаче има и предупреждение: "Дисклеймър: Материалът е взет от интернет; моля, проверявайте внимателно."

"Сателитно" изображение, създадено с AI

Използването на макети на военна техника с цел заблуда на противника е широко разпространена практика при военни конфликти. Иран също е използвал такива, например по време на Ирано-иракската война от 1980 до 1988 г., когато страната използва плаващи примамки с радарни отражатели (архивирана връзка).

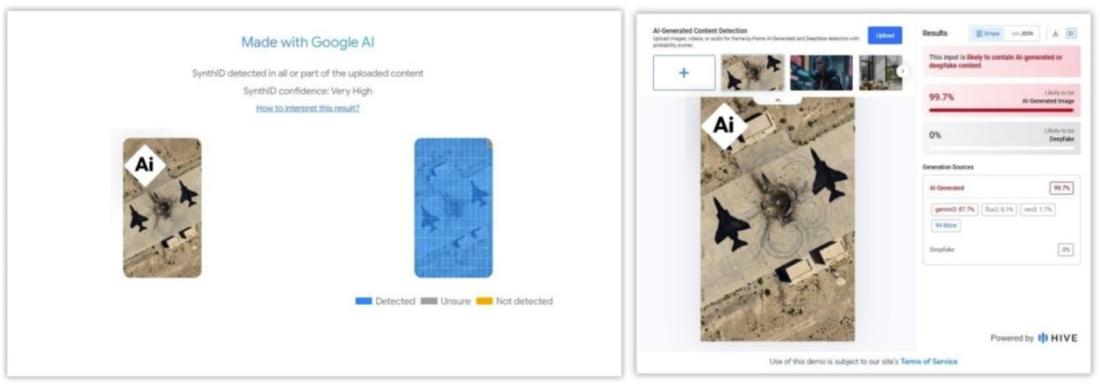

AFP обаче откри множество визуални следи, които показват, че разпространяваното в социалните мрежи сателитно изображение не е истинско.

Например изписаните координати в краищата на изображението са напълно объркани. Обозначението "E" ("изток") се появява там, където обикновено би трябвало да бъде "N" ("север"), а маркерите за географска ширина и дължина не съответстват на никоя разпознаваема глобална координатна система.

Силуетите на изтребителите изглеждат напълно еднакви, сякаш са дублирани, и са непропорционално големи спрямо околните сгради. Зоната на взрива също е необичайно симетрична.

Изображението също така изглежда прекалено ясно и с необичайно наситен контраст, за разлика от реалните сателитни изображения, които обикновено са леко замъглени и показват изкривявания.

AFP анализира изображението с два инструмента за разпознаване на AI съдържание.

Моделът Gemini на Google откри в изображението SynthID – вграден невидим воден знак, който според Google е предназначен да идентифицира AI съдържание, създадено с помощта на инструментите на компанията. При обратно търсене в секцията "За това изображение" Google отново посочва, че то е "създадено с Google AI".

Анализ с инструмента Hive Moderation също показа 99-процентова вероятност изображението да е генерирано с изкуствен интелект.

Войната в Близкия изток предизвика вълна от дезинформация. От началото на операцията на Израел и САЩ срещу Иран AFP опроверга множество подвеждащи и генерирани с изкуствен интелект снимки и видеа. Прочетете нашите проверки тук.

Copyright © AFP 2017-2026. Всяко използване на това съдържание с търговска цел изисква абонамент. Кликнете тук, за да научите повече.

Видели сте съдържание, което искате AFP да провери?

Свържи се с нас