Осем съвета за разпознаване на изображения, създадени с изкуствен интелект

- Тази статия е на повече от една година.

- Публикувано на 17 януари 2025 г. в 10:49

- Време за четене: 5 минути

- От: AFP Франция

- Превод и адаптация: Rossen BOSSEV

Снимка, видео или аудио: независимо под каква форма, съдържанието, генерирано от изкуствен интелект (ИИ), вече се разпространява в социалните мрежи, благодарение на възхода на инструментите за създаването му (например MidJourney, DALL-E, Imagen и Synthesia), които стават все по-достъпни за широката публика.

Този разрастващ се поток от изкуствено създадени публикации се споделя както за забавление, така и за дезинформация - особено когато създадените с ИИ изображения са извадени от оригиналния им контекст.

Към настоящия момент няма инструмент, който да е 100% надежден в откриването на съдържание, създадено с ИИ. AFP обаче предлага осем съвета, които биха ни помогнали да открием съдържание, генерирано с тази технология.

1. Търсете думите "генерирано от изкуствен интелект"

Бележки като "Made with AI" (Създадено с ИИ) или "AI-generated content" (съдържание, генерирано от ИИ) се срещат в някои от публикациите, споделяни в социалните мрежи. Тези надписи са ясна следа, която да ви помогне да разберете, че видеото не е оригинално.

Някои платформи, като Instagram и TikTok, добавят този етикет автоматично, веднага щом открият съдържание, генерирано или модифицирано от ИИ (архивни връзки тук и тук).

Създателите на такова съдържание могат също така сами да добавят този етикет, когато го публикуват онлайн.

Скрийншот, направен в TikTok на 02 декември 2024 г., Ограждането в червено е добавено от AFP

Но внимавайте: не всички изкуствено създадени изображения са обозначавани като такива. И обратното, възможно е дадено изображение да бъде определено като създадено от изкуствен интелект, но то да е органично.

2. Разгледайте източника на съдържанието

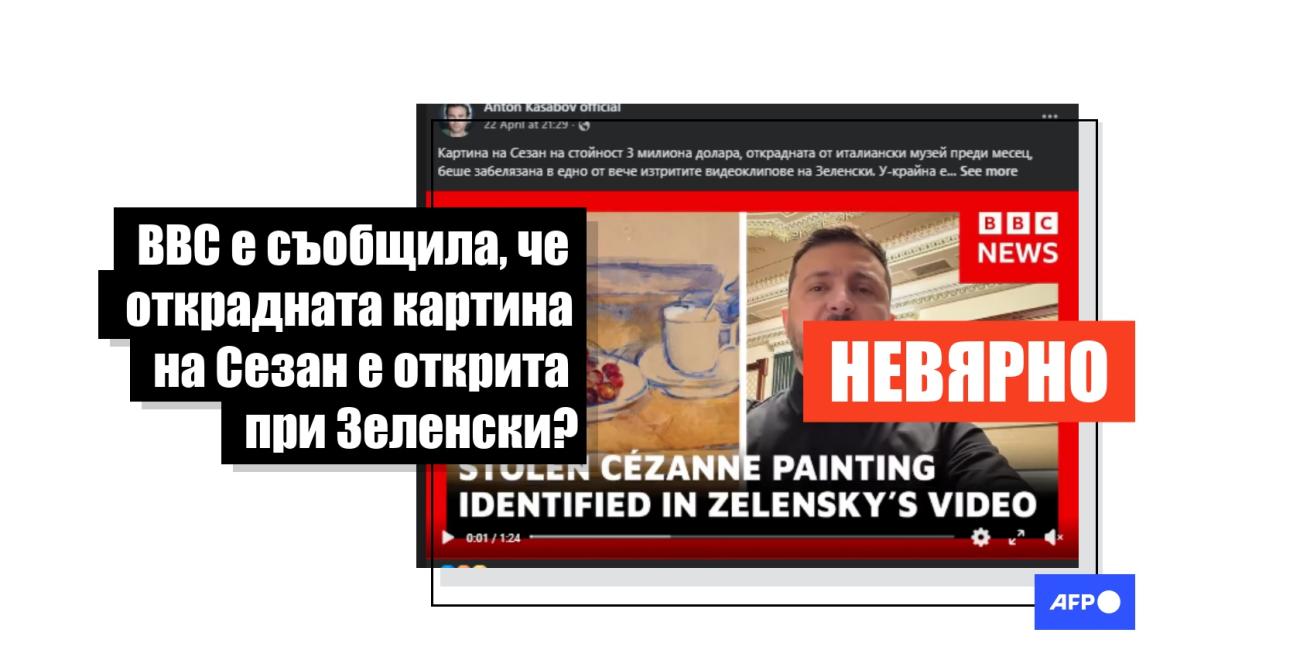

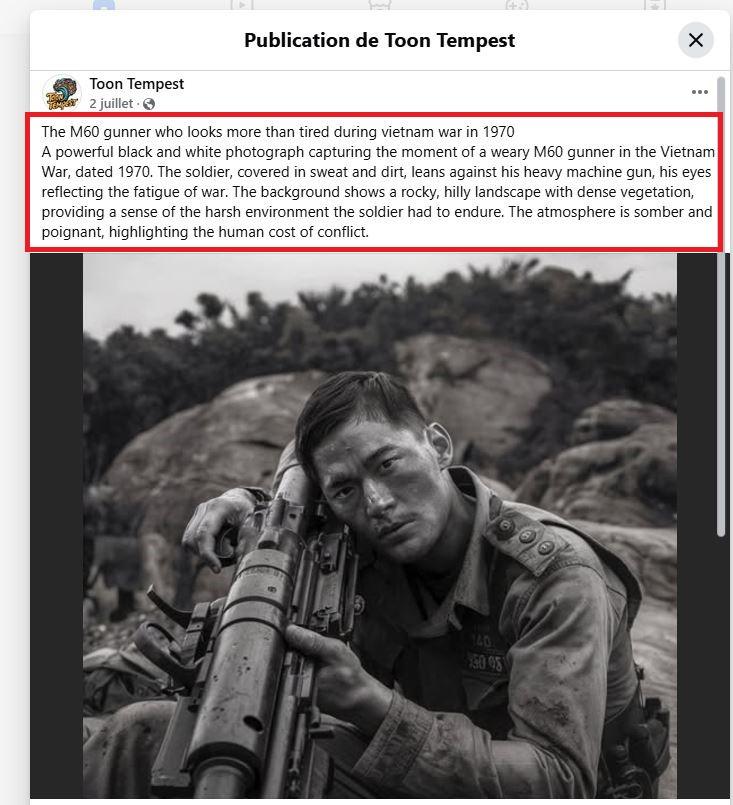

Изморен войник си почива, опирайки се на оръжието си в разгара на Виетнамската война: това изображение, споделено във Facebook, изглежда съвсем реалистично, но е създадено с ИИ.

Това може да се разбере от редица детайли, като се започне с надписа, придружаващ изображението - който не е нищо друго освен командата ("prompt" на английски), зададена до изкуствения интелект, за да генерира тази картинка.

Екранна снимка, направена от Facebook на 2 декември 2024 г.

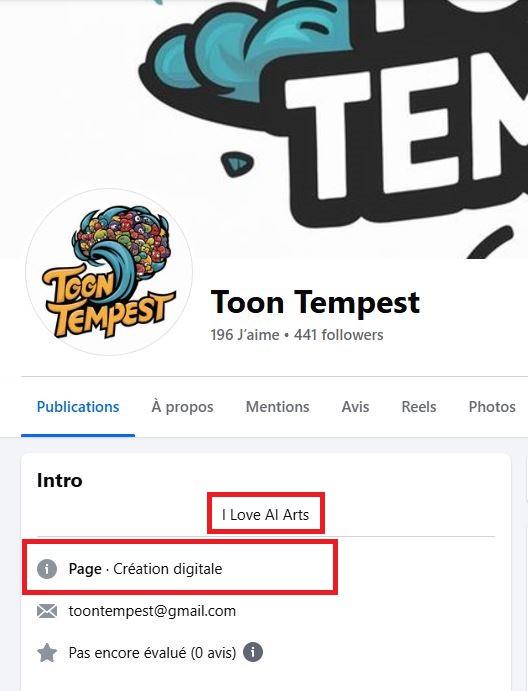

Нещо повече, ако погледнем Facebook страницата, ще видим, че е посочено, че "обича изкуството на изкуствения интелект" и е специализирана в "цифровото творчество". Това може да се види и в други публикации, които включват командата, зададена до ИИ, за да се генерира съответното изображение.

Екранна снимка, направена от Facebook на 2 декември 2024 г.

3. Проверете "информация"

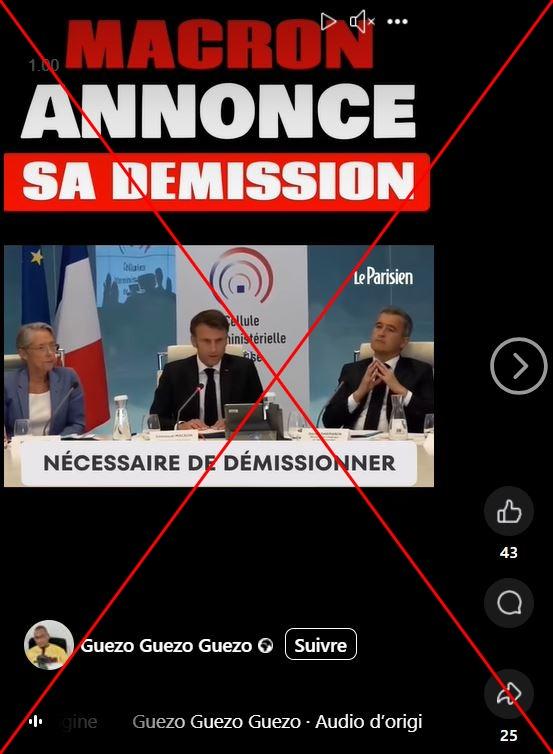

В заглавието на този видеоклип, споделен през септември 2023 г., се твърди, че Еманюел Макрон е "обявил оставката си".

Държавният глава обяснява с глас, който наподобява неговия, че "недоволството" и "неудовлетворението" на френския народ от неговото "управление", изразено по-специално чрез освирквания по време на церемонията по откриването на Световната купа по ръгби във Франция през 2023 г., го е накарало да вземе "трудното, но необходимо решение да подаде оставка от [своите] задължения като президент на Републиката".

Скрийншот, направен в TikTok на 12.02.2024 г., червен кръст, добавен от AFP

Без съмнение подобно извънредно събитие щеше да бъде отразено от медиите.

Простото търсене на ключови думи по темата показва, че такова изявление никога не е било правено. Нещо повече, оригиналното видео, на което е записан фалшивият аудиозапис, може да бъде проследено по редица обозначения върху изображенията (включително "30 юни 2023 г." и Le Parisien).

Както обяснихме в статията, публикувана през септември 2023 г., това е видеоклип на всекидневника, публикуван онлайн на 30 юни 2023 г.

Заснет е по време на заседание на междуведомственото кризисно звено, чието лого се вижда зад президента, създадено в отговор на безредиците след смъртта на младия Нахел, убит по време на полицейска проверка в парижкото предградие Нантер на 27 юни същата година.

В него Еманюел Макрон "осъжда" насилието в града и обявява увеличаване на полицейските ресурси, за да се сложи край на безредиците, т.е. няма нито дума за оставка, както се твърди.

4. Изображения, които са твърде съвършени

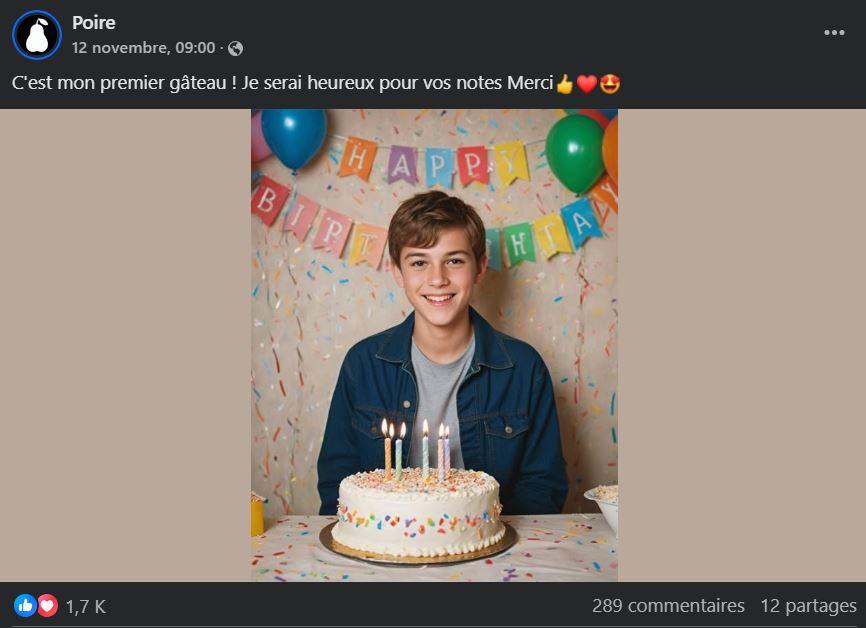

Бебе, което свири на китара, дете, което празнува рождения си ден, или дори възрастни хора, които гордо събират картофи: тези снимки, споделени във Facebook, изглеждат съвършени от естетическа гледна точка и предизвикват редица възторжени коментари в платформата.

Но при внимателно разглеждане можем да видим, че кожата и косата на тези хора изглеждат твърде гладки и неестествени.

Екранни снимки, направени във Facebook на 2 декември 2024 г.

Всяко от тези изображения има и редица малки недостатъци, които издават използването на изкуствен интелект: бебето има само четири пръста, а надписът "Честит рожден ден" е изписан погрешно.

Скрийншот от Facebook, направен на 2 декември 2024 г.

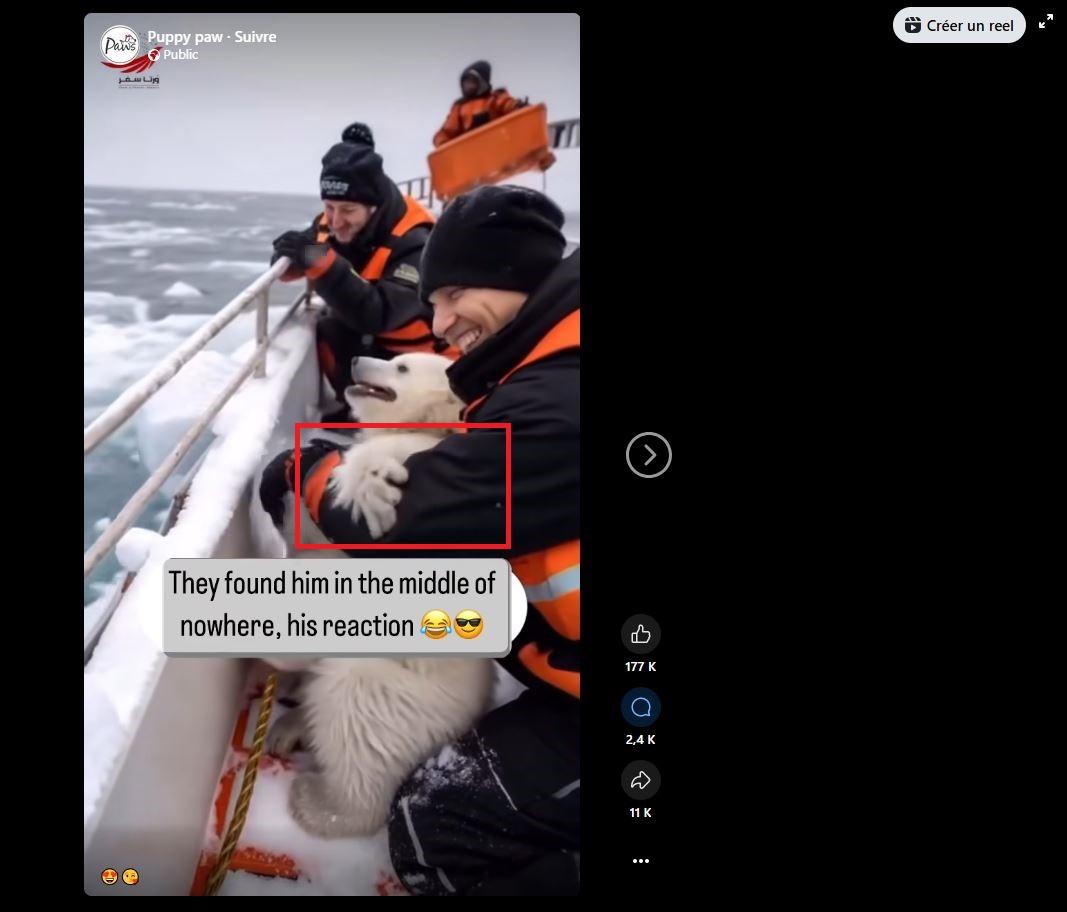

Същото важи и за този видеоклип, станал изключително популярен, който уж показва, че моряците прегръщат полярно мече, което са срещнали по време на плаването.

Екранна снимка на Facebook пост, направена на 2 декември 2024 г.

Tрогателните изображения играят на струната на емоциите на интернет потребителите.

Но те не са верни, както може да се разбере от прекалено изчистения и перфектен външен вид на мечката и някои детайли, като например лапите ѝ, които на моменти придобиват човешка морфология.

Екранна снимка на Facebook пост, направена на 2 декември 2024 г.

5. Наблюдавайте фона на изображенията

Надуваем балон с лика на Доналд Тръмп по време на известния парад за Деня на благодарността в Ню Йорк?

При по-внимателно вглеждане във фона на това изображение, разпространявано в социалните мрежи, се откриват различни улики, че то е генерирано от изкуствен интелект.

Екранна снимка на Facebook пост, направена на 2 декември 2024 г.

По-специално, лицата на различни минувачи в тълпата са непълни или изкривени.

Балонът, наподобяващ Доналд Тръмп, също е държан по нереалистичен начин само от няколко души, които едва ли могат да поддържат такава внушителна инсталация.

Екранна снимка на Facebook пост, направена на 2 декември 2024 г.

6. Обърнете внимание на историческите несъответствия

"Откриване на Айфеловата кула, 1889 г.", гласи надписът на черно-бяла снимка, споделена във Facebook.

Само че на нея се вижда как няколко души от тълпата снимат известната атракция със... смартфони. Понякога здравият разум е всичко, от което се нуждаете, за да разпознаете изображение, генерирано от изкуствен интелект.

Екранна снимка на Facebook пост, направена на 2 декември 2024 г.

7. Потърсете превод

Еманюел Макрон говори на арабски? Поне това показва това видео, споделено от редица интернет потребители, които мимоходом ни уверяват, че френският президент е обявил преподаването на този език още "от детската градина“.

Това обаче е deepfake (аудио или видео съдържание, модифицирано с помощта на изкуствен интелект, за да накара някого да изглежда, че казва или прави нещо, което не е казал или правил).

Екранна снимка на TikTok, направена на 2 декември 2024 г.

Ако се вслушате внимателно в този откъс, можете да разберете, че той е генериран от изкуствен интелект. Тишината на заден план, докато държавният глава говори на открито пред голяма аудитория, е важна улика, както и донякъде роботизираното му дишане.

Може да се наблюдава и движението на устните му, което понякога е неестествено и зле синхронизирано с думите му.

8. Използвайте обратно търсене на изображения

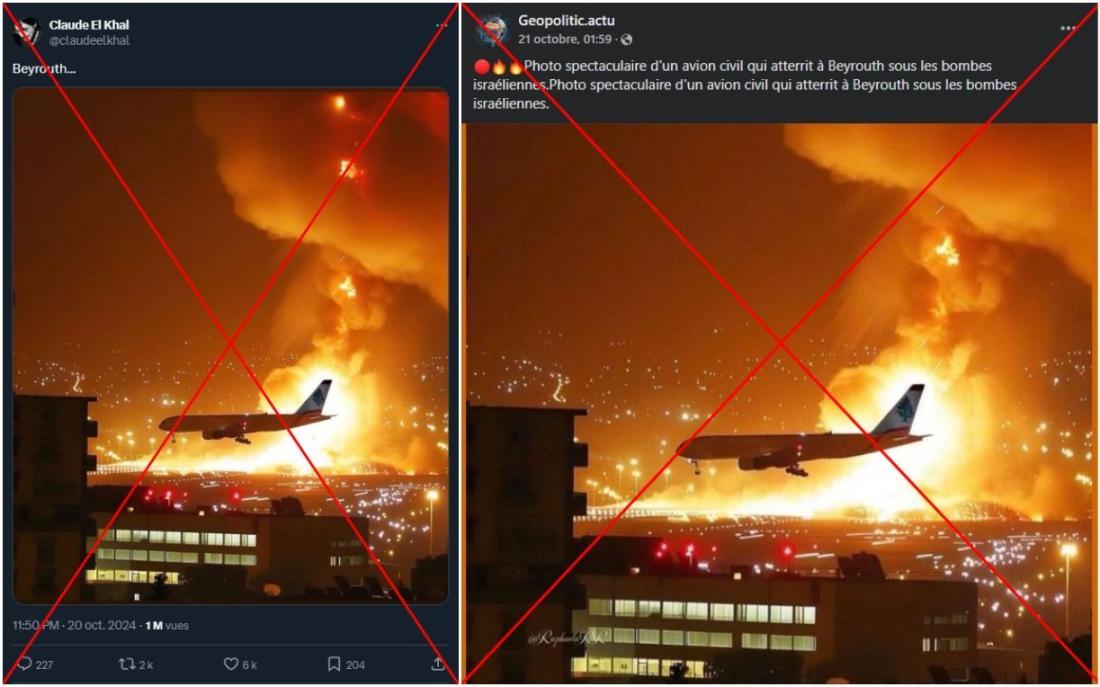

Това изображени на самолет, прелитащ близо до мястото на мощната експлозия на летището в Бейрут, Ливан, предизвиква множество повторения и реакции през есента на 2024 г. в контекста на серия удари на израелската армия по ливанската столица на 20 октомври 2024 г., които бяха насочени срещу финансови институции, свързани с Хизбула.

Снимки на екран, направени от X (вляво) и Facebook (вдясно) на 23 октомври 2024 г.

Обратното търсене на изображения, съчетано с разширено търсене в интернет, позволява изображението да бъде намерено в няколко акаунта в Instagram (тук или тук), където е посочено, че то е "генерирано от ИИ".

Предимството на обратното търсене на изображения е и в това, че се откриват подобни снимки, както обясни AFP още през март 2023 г. Това може да бъде безценно за сравняване на снимка, за която се подозира, че е генерирана от ИИ, със снимки от надеждни източници.

По време на широко разгласената среща между Владимир Путин и Си Дзинпин в социалните мрежи по това време се разпространяваше снимка без източник, на която руският президент е коленичил пред китайския лидер.

Както посочи италианският журналист Давид Пуенте обаче, обстановката на тази снимка е много различна от тази, показана на други медийни изображения, отразяващи събитието, което поражда съмнения относно автентичността на снимката.

Copyright © AFP 2017-2026. Всяко използване на това съдържание с търговска цел изисква абонамент. Кликнете тук, за да научите повече.

Видели сте съдържание, което искате AFP да провери?

Свържи се с нас